Cân bằng hiệu năng và mật độ máy ảo: Bài toán thực tế

Anh em khi mới dựng lab Proxmox thường mắc lỗi tâm lý “thừa còn hơn thiếu”. Chúng ta có xu hướng cấp phát tài nguyên vô tội vạ cho máy ảo (VM). Tuy nhiên, gán quá nhiều vCPU hay RAM không giúp VM nhanh hơn. Ngược lại, nó còn kéo lùi hiệu suất của toàn bộ Hypervisor do tranh chấp tài nguyên.

Mình đang vận hành một cụm homelab với 12 VM và container đủ loại. Từ kinh nghiệm xử lý những pha node bị treo cứng do nghẽn Disk I/O, mình rút ra rằng: Hiểu đúng cơ chế phân bổ là chìa khóa để hệ thống chạy ổn định 24/7. Bạn không cần phần cứng khủng, bạn chỉ cần cấu hình thông minh.

Over-provisioning vs. Fixed Allocation: Chọn phe nào?

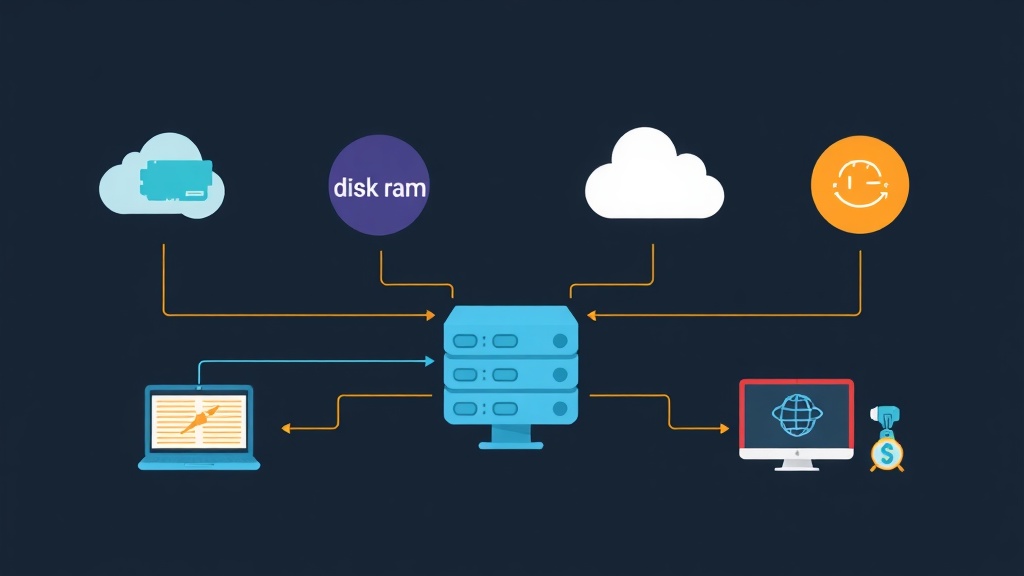

Trong ảo hóa, có hai trường phái quản lý tài nguyên mà bạn cần phân biệt rõ:

1. Over-provisioning (Cấp phát vượt ngưỡng)

Đây là cách gán tổng tài nguyên VM lớn hơn thực tế máy vật lý có. Ví dụ: Server chỉ có 32GB RAM nhưng bạn gán cho 10 VM, mỗi con 4GB (tổng 40GB).

- Ưu điểm: Tận dụng triệt để phần cứng, cực kỳ tiết kiệm chi phí.

- Rủi ro: Nếu tất cả VM cùng đạt đỉnh (peak) tải, Hypervisor sẽ tràn RAM, dẫn đến swap liên tục hoặc crash hệ thống.

2. Fixed Allocation (Cấp phát cố định)

Mỗi VM chiếm giữ một phần tài nguyên riêng biệt. Hypervisor sẽ “lock” phần đó lại, không cho đứa khác đụng vào.

- Ưu điểm: Hiệu năng ổn định tuyệt đối, không có hiện tượng tranh giành.

- Nhược điểm: Lãng phí nếu VM chỉ chạy idle ở mức 5-10% tải.

Kinh nghiệm của mình: Với CPU, bạn có thể thoải mái Over-provisioning theo tỷ lệ 1:3 (1 core vật lý gán cho 3 vCPU). Riêng với RAM, hãy cực kỳ cẩn trọng. Chỉ nên dùng Ballooning cho môi trường test.

Tối ưu CPU: Đừng để vCPU trở thành gánh nặng

Gán 8 vCPU cho một VM trên con host chỉ có 4 core vật lý là sai lầm cơ bản. Lúc này, hiện tượng Context Switching sẽ xảy ra liên tục. CPU phải mất công chuyển đổi qua lại giữa các tác vụ, khiến độ trễ (latency) tăng vọt.

Chuyển ngay sang CPU Type “Host”

Mặc định Proxmox dùng kvm64 để đảm bảo bạn có thể live-migrate VM sang các server đời cũ. Tuy nhiên, kvm64 lại ẩn đi các tập lệnh quan trọng như AES-NI hay AVX. Nếu không có ý định chạy cụm cluster gồm nhiều đời chip khác nhau, hãy đổi sang host để tận dụng 100% sức mạnh chip thật.

# Ép VM ID 100 sử dụng tập lệnh của CPU vật lý

qm set 100 --cpu hostSức mạnh của NUMA và CPU Pinning

Với các server Dual Socket, hãy bật tính năng NUMA (Non-Uniform Memory Access). Nó giúp VM nhận biết được thanh RAM nào nằm gần CPU nào, giảm thiểu độ trễ truy xuất dữ liệu qua bus hệ thống.

Nếu chạy Database lớn, hãy cân nhắc dùng CPU Pinning. Kỹ thuật này gắn chặt vCPU vào một Core vật lý cố định, giúp dữ liệu luôn nằm trong L1/L2 cache, tăng tốc xử lý đáng kể.

Quản lý RAM: Nghệ thuật dùng Ballooning

Cơ chế Memory Ballooning hoạt động ra sao?

Hãy tưởng tượng Ballooning như một quả bóng trong bụng VM. Khi Hypervisor thiếu RAM, nó sẽ thổi phồng quả bóng này để chiếm chỗ, buộc VM phải nhường RAM lại cho Host. Để tính năng này chạy được, bạn phải cài qemu-guest-agent.

# Cài đặt agent trên Ubuntu/Debian

sudo apt update && sudo apt install qemu-guest-agent -y

sudo systemctl enable --now qemu-guest-agentCảnh báo: Tuyệt đối không dùng Ballooning cho MySQL, PostgreSQL hay Redis. Database luôn muốn cache mọi thứ vào RAM. Nếu bị giật lại RAM đột ngột, service sẽ bị đứng hình hoặc crash ngay lập tức.

Disk I/O: Xử lý điểm nghẽn khó chịu nhất

Trong ảo hóa, Disk I/O thường là thứ nghẽn đầu tiên. Khi chỉ số IO Wait trên 10%, bạn sẽ thấy mọi thao tác trên VM đều có cảm giác “lag” dù CPU vẫn rảnh.

Kích hoạt VirtIO SCSI Single và IO Thread

Đừng dùng trình điều khiển mặc định. Hãy chọn VirtIO SCSI Single để mỗi ổ đĩa ảo có một hàng đợi (queue) riêng. Đặc biệt, hãy bật IO Thread. Tùy chọn này cho phép các thao tác đọc ghi chạy trên một luồng CPU riêng, không làm nghẽn luồng xử lý chính của VM.

# Ví dụ cấu hình tối ưu trong file /etc/pve/qemu-server/100.conf

scsihw: virtio-scsi-single

virtio0: local-lvm:vm-100-disk-0,iothread=1,discard=onGiới hạn băng thông (Rate Limiting) để tránh “hàng xóm ồn ào”

Một VM chạy backup có thể hút cạn băng thông ổ cứng, khiến các VM khác chết đứng. Mình thường giới hạn tốc độ cho các VM không ưu tiên ở mức 50MB/s hoặc 100MB/s để đảm bảo công bằng.

# Giới hạn VM 100 chỉ được đọc/ghi tối đa 50MB/s

qm set 100 --virtio0 local-lvm:vm-100-disk-0,bwlimits=read=50,write=50Quy trình tối ưu hóa chuẩn cho anh em

Để Hypervisor chạy mượt, mình luôn tuân thủ 4 bước sau:

- Giám sát: Dùng

htopvàiostat -x 1để tìm ra VM nào đang gây nghẽn. - CPU: Luôn chọn

Type: Host. Tỷ lệ vCPU:pCPU không nên quá 4:1 cho workload nhẹ. - RAM: Cấp phát cố định cho Database. Chỉ dùng Ballooning cho web server hoặc proxy.

- Disk: Ưu tiên SSD/NVMe, dùng

VirtIO SCSI Singlevà luôn bậtDiscardđể giải phóng dung lượng trống.

Tối ưu tài nguyên là một hành trình tinh chỉnh liên tục. Hy vọng những mẹo thực chiến này giúp anh em làm chủ được con quái vật KVM/Proxmox của mình.