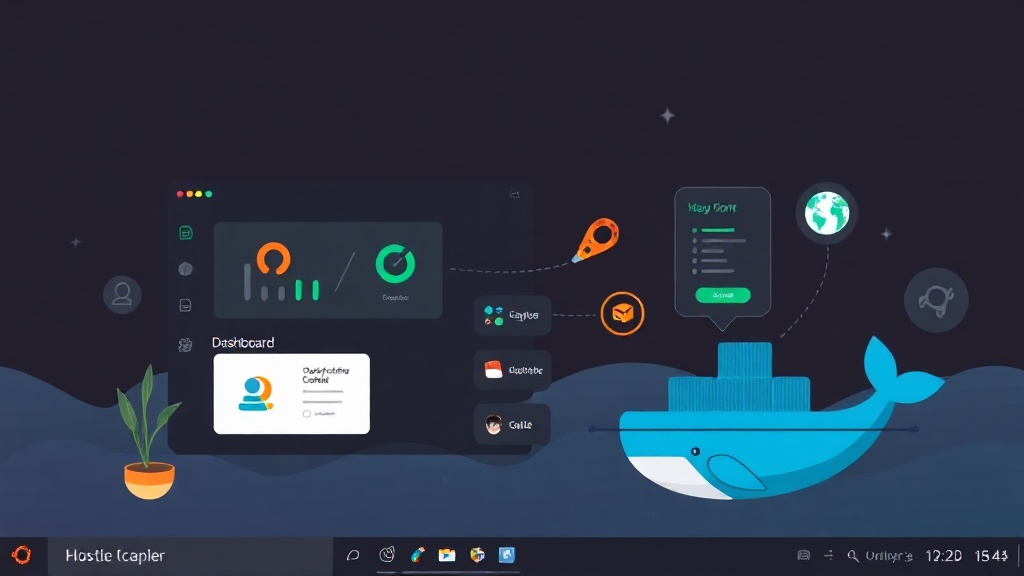

Posted inUbuntu

Tự dựng DNS Server nội bộ với BIND9 trên Ubuntu: Giải pháp thay thế file hosts “cồng kềnh”

Quên việc sửa file hosts thủ công đi! Hướng dẫn cài đặt BIND9 trên Ubuntu Server giúp bạn quản lý tên miền nội bộ chuyên nghiệp, kèm theo những lưu ý thực tế để tránh lỗi hệ thống.